- 政府努力表明,现实世界的AI解决方案需要明确的目标、社区参与和透明度,以便与公众建立信任。

- 企业在整合生成式AI(GenAI)方面具有巨大的潜力,但在扩大这些AI能力的过程中存在一些必须解决的障碍。

- 游戏行业有潜力通过AI与玩家建立更深层次的连接,但它也面临着与其他AI应用一样的伦理风险。

- 自主代理似乎是AI的下一个重要发展步伐,预计从2025年开始,相关应用将变得普及。

图片来源:Counterpoint Research

AI时代已经到来,企业必须采用它,否则将被淘汰。 这正是12月11日至12日于纽约举办的“AI峰会”传达的明确信息,得到了各领域专家的支持。政府领导人、企业战略家、技术开发者和游戏设计师齐聚一堂,讨论了AI当前的发展状况以及未来的走向。

“扩展”成为了本次峰会的热词,许多演讲者强调,既然企业现在已经拥有技术,下一步应该是将其以最有效的方式融入到商业模式中。峰会的总体信息是,AI不再是技术界的一种“炒作”,它已经来到并正在重塑公共服务、企业决策和娱乐行业。同时,峰会讨论了如何消除企业和政府对AI的负面看法,包括隐私和透明度问题,并赢得客户的信任,从而全面推动AI应用。

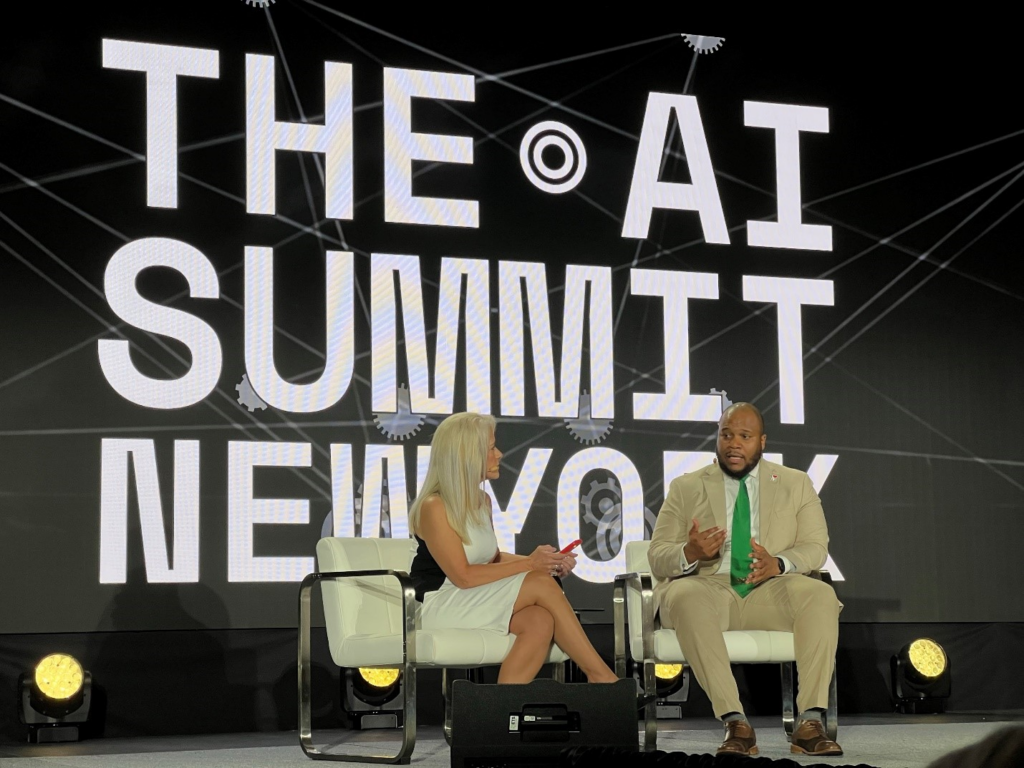

纽约市首席技术官马修·弗雷泽(右)正在讨论人工智能与政策的融合。

来源:Counterpoint Research

公共AI

纽约市首席技术官(CTO)马修·弗雷泽(Matthew Fraser)展示了AI如何为公众带来福祉。他介绍了政府如何将AI融入到城市的日常生活中。纽约市没有等待科技公司来设定议程,而是明确了自己的目标,例如帮助市民了解并获得他们有资格享受的当地服务,并利用AI更高效地接触到他们。关于AI的讨论总是伴随着公众对其信任和认知问题。弗雷泽提到的一些解决方案包括举办公开市政会议、制定透明的数据政策,并从早期的聊天机器人错误中吸取教训。这提醒我们,AI只有在人们理解它、对其感到舒适并知道他们的利益得到保护时,才能真正赋能社区。

企业AI

在企业层面,像强生和辉瑞这样的公司强调了良好治理的重要性。他们已经在“负责任的AI”框架中进行了大量投资——培训员工、监控模型性能,并密切关注数据隐私和偏见问题。生成式AI(GenAI)非常有用,但也有可能输出无意义的信息或从可疑来源抓取数据。企业知道,他们需要建立防范措施,既保护自己的声誉,又确保客户持续信任他们的品牌。在将AI引入商业模式后,他们已经注意到业务流程中的效率得到了提高,成本得到了降低,从而减少了压力,提升了产品的一致性。

AI在游戏中的应用

游戏一直是测试AI能力的有趣和富有创造性的方式,但它也可以突出AI在社会中固有的问题。一些开发者对使用生成式AI创造更丰富、更适应玩家行为的游戏世界感到兴奋,以此提供更独特的游戏体验。但也存在市场可能会充斥着大量的通用游戏的内在担忧。独立游戏开发者以推动创新和创作新游戏内容而闻名。但由于时间和资源(尤其是财务资源)的限制,AI可能导致大型公司以比独立开发者更快的速度生产游戏,超出后者的竞争能力。此外,AI生成的内容可能带来隐性偏见或操控手段,部分大型语言模型(LLMs)未得到适当监控或训练,这已成为一个问题。如何在创新与伦理、原创性之间找到平衡,将是游戏行业面临的一大挑战。